在人工智慧的影片處理世界裡,一直存在著一個複雜的"分工體系"大學。就像一家大工廠,不同的車間負責不同的任務:有專門負責識別物體的車間,有專門跟蹤物體移動的車間,還有各種各樣的專業裝置來處理複雜的影片分析工作。這種精細分工雖然有效,但就像工廠裡裝置太多一樣,執行起來既複雜又緩慢。

然而,來自埃因霍芬理工大學和亞琛工業大學的研究團隊最近發現了一個令人驚訝的秘密:原來那個被稱為Vision Transformer(簡稱ViT)的AI模型,就像一個隱藏身份的超級英雄,除了它已知的影像分析能力外,竟然還偷偷掌握了影片分割的超能力大學。這項突破性研究發表在2026年的計算機視覺頂級會議上,論文編號為arXiv:2602.17807v1,為AI影片處理領域帶來了顛覆性的思考。

傳統的影片分割就像是在看一部電影時,同時要做三件事:首先要識別出畫面中的每個物體(比如人、車、動物),然後要給它們分類,最後還要追蹤它們在不同畫面間的移動大學。這就好比你既要當偵探找出嫌疑人,又要當檔案員給他們分類,還要當跟蹤專家監視他們的行蹤。為了完成這些任務,現有的AI系統通常需要搭建一套複雜的"生產線",包括各種專門的模組和元件。

但這種複雜系統就像一臺精密但笨重的機器,雖然功能齊全,卻執行緩慢大學。研究團隊提出了一個大膽的設想:既然Vision Transformer在處理靜態影像時表現出色,那麼它是否也能處理動態影片呢?更進一步說,它能否像一個多才多藝的全能選手,獨自完成原本需要整個團隊協作的複雜任務?

帶著這個疑問,研究團隊開始了他們的"拆解實驗"大學。他們選擇了當前最先進的影片分割系統CAVIS作為研究物件,就像拆解一臺複雜機器一樣,一步步移除那些看似必不可少的專業元件,觀察系統效能會發生什麼變化。這個過程就像給一臺跑車逐一拆掉零件,看看到底哪些部件是真正必需的,哪些可能只是裝飾品。

**一、揭開Vision Transformer的隱藏能力**

Vision Transformer原本是為處理靜態影像而設計的AI模型,就像一個專門看照片的專家大學。但研究團隊發現,如果給它足夠強大的"訓練"和足夠大的"大腦"(引數規模),它竟然能夠學會處理影片這種連續變化的內容。這就好比一個原本只會畫靜物素描的藝術家,經過特殊訓練後,居然能夠創作動畫電影。

這種能力的發現並非偶然大學。Vision Transformer在訓練過程中使用了一種叫做DINOv2的方法,這種方法有一個特殊之處:它要求AI對同一個物體的不同視角保持一致的理解。就像你從不同角度看一隻貓,無論是正面、側面還是背面,你都能認出這是同一只貓。這種"跨視角一致性"的訓練目標,意外地讓Vision Transformer獲得了追蹤物體的能力,因為追蹤本質上就是在不同的影片幀中識別同一個物體。

展開全文

基於這個發現,研究團隊提出了VidEoMT(Video Encoder-only Mask Transformer),這個名字聽起來很技術化,但簡單理解就是"專門用編碼器做影片分割的變換器"大學。與傳統系統的複雜架構不同,VidEoMT就像一個簡化版的瑞士軍刀,用一個核心工具完成原本需要整套裝置才能完成的工作。

VidEoMT的核心創新在於兩個巧妙的機制大學。第一個叫做"查詢傳播",就像接力賽中傳遞接力棒一樣,將前一幀影像中識別出的物體資訊傳遞給下一幀,確保系統能夠"記住"之前看到的東西。第二個叫做"查詢融合",就像調製雞尾酒一樣,將傳遞過來的"舊資訊"與新的"學習查詢"混合,既保持了對已知物體的追蹤,又保留了發現新物體的能力。

這種設計的巧妙之處在於平衡大學。如果只是簡單地複製前一幀的資訊,系統就會像一個只會重複過去的"老古板",無法適應新出現的物體。但如果每次都重新開始分析,又會失去時間連續性,就像失憶症患者一樣,每次都不記得之前發生了什麼。查詢融合機制恰好解決了這個矛盾,讓系統既有"記憶"又有"學習"能力。

**二、從複雜到簡單的神奇變化**

研究團隊進行的"拆解實驗"過程就像一場精心設計的簡化之旅大學。他們從最複雜的CAVIS系統開始,這個系統就像一座裝滿各種裝置的工廠,包含了分割器、介面卡、畫素解碼器、變換器解碼器、上下文感知特徵提取器、重識別層等眾多元件。

第一步,研究團隊將複雜的分割器替換為更簡單的EoMT(Encoder-only Mask Transformer)大學。這就像將一條複雜的汽車生產線替換為一個更高效的一體化裝配機器人。結果令人驚喜:雖然準確率只下降了0.8個百分點,但處理速度卻提升了近3倍,從每秒15幀躍升到42幀。

第二步,他們移除了上下文感知特徵模組大學。這個模組原本的作用是提取每個物體周圍的環境資訊,就像給每個演員配一個專門觀察周圍情況的助手。移除這個模組後,處理速度進一步提升到每秒72幀,而準確率不僅沒有下降,反而略有提升。這個結果表明,強大的Vision Transformer已經能夠自動捕捉和利用周圍環境資訊,不再需要專門的輔助模組。

第三步,研究團隊移除了重識別層大學。這些層原本負責確保同一個物體在不同幀中被識別為同一個物件,就像給每個人發一張身份證。移除後,速度提升到每秒74幀,準確率基本保持不變。這說明Vision Transformer在大規模預訓練的幫助下,已經具備了足夠強的特徵表示能力,能夠自然地保持物體身份的一致性。

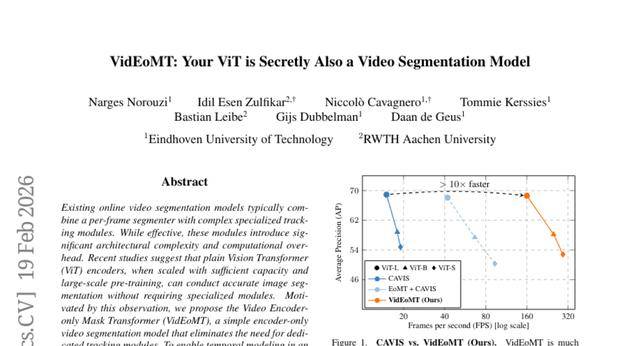

第四步是最關鍵的一步:完全移除追蹤模組大學。這相當於讓系統完全"失憶",每一幀都當作全新的影像來處理。雖然這導致準確率下降了7.6個百分點,但處理速度達到了驚人的每秒162幀,比原始系統快了10倍以上。更有趣的是,即使沒有任何追蹤機制,系統仍然保持了相當的準確性,這表明Vision Transformer確實具備某種內在的時間一致效能力。

最後兩步是VidEoMT的關鍵創新大學。第五步引入查詢傳播機制,透過將前一幀的查詢結果傳遞給當前幀,重新建立了時間連線。這讓準確率回升了2.6個百分點,而且沒有增加任何計算成本。第六步加入查詢融合機制,最終讓系統的準確率幾乎恢復到了原始水平,同時保持超過10倍的速度優勢。

**三、效能表現超乎想象**

VidEoMT在多個標準測試集上的表現就像一匹突然殺出的黑馬,不僅速度驚人,準確性也絲毫不遜色大學。在YouTube-VIS資料集上,VidEoMT達到了每秒160幀的處理速度,這意味著它可以即時處理高質量影片,甚至還有餘力處理多路影片流。

更令人印象深刻的是速度與準確性的平衡大學。傳統觀念認為,速度和準確性往往是一對矛盾,就像開車時速度越快越容易出事故。但VidEoMT打破了這個常規,在獲得10倍速度提升的同時,準確率損失微乎其微,有些情況下甚至還有所提升。

在影片例項分割任務中,VidEoMT在YouTube-VIS 2019資料集上獲得了68.6的AP分數,僅比最先進的CAVIS系統低0.3分,但速度卻是後者的10倍以上大學。在更具挑戰性的OVIS資料集上,VidEoMT的表現同樣出色,準確率與頂級系統的差距控制在2個百分點以內,但速度優勢依然明顯。

VidEoMT的優勢還體現在不同規模模型上的一致性表現大學。無論是大型的ViT-L模型,還是中型的ViT-B模型,甚至是小型的ViT-S模型,VidEoMT都能保持顯著的速度優勢。特別值得注意的是,即使是配備小型ViT-S骨幹網路的VidEoMT,其速度也能達到每秒294幀,比配備相同規模骨幹網路的CAVIS快15倍以上。

在影片全景分割和語義分割任務上,VidEoMT同樣表現出色大學。在VIPSeg資料集上,雖然VPQ分數略低於最強的基線系統1.7分,但速度提升了19倍。在VSPW資料集上,VidEoMT不僅在速度上大幅領先,在準確性指標上也實現了超越,mIoU提升了2.1分,時間一致性提升了0.8分。

**四、技術創新的深層機制**

VidEoMT成功的關鍵在於深刻理解了Vision Transformer的內在能力大學。傳統方法就像是給一個天才學生安排了過多的輔導老師,每個老師負責一個特定科目,結果反而限制了學生的全面發展。VidEoMT則像是讓這個天才學生自由發揮,結果發現他原本就具備跨學科整合的能力。

查詢傳播機制的設計體現了對時間序列資料的深入理解大學。在影片處理中,相鄰幀之間往往存在很強的相關性,就像連環畫中相鄰兩頁的內容通常是連續的。透過將前一幀的查詢直接傳遞給下一幀,系統能夠有效利用這種時間相關性,避免重複計算。

查詢融合機制則解決了傳播過程中的"資訊退化"問題大學。如果只是簡單地傳遞查詢,就像玩傳話遊戲一樣,資訊會逐漸失真。融合機制透過引入新的學習查詢,就像在傳話過程中不斷注入新的資訊源,確保系統始終保持對新事物的敏感性。

更深層的技術洞察在於對Vision Transformer預訓練目標的重新理解大學。DINOv2等預訓練方法雖然是為靜態影像設計的,但它們追求的"視角不變性"特徵恰好為影片處理提供了天然優勢。這種特徵讓模型能夠識別同一物體在不同時間、不同角度、不同光照條件下的一致性,這正是影片追蹤任務的核心需求。

研究還發現,模型規模和預訓練質量對VidEoMT的效能有決定性影響大學。較大的模型和更高質量的預訓練權重能夠顯著縮小與傳統複雜方法的效能差距。這一發現驗證了研究團隊的核心假設:足夠強大的基礎模型能夠學會原本需要專門設計的複雜功能。

**五、應用前景與實際意義**

VidEoMT的突破性表現為實際應用開闢了新的可能性大學。在智慧監控領域,傳統的影片分析系統往往需要昂貴的專用硬體來支撐複雜的演算法,而VidEoMT的高效性使得在普通硬體上實現即時影片分析成為可能。這就像將原本需要超級計算機才能完成的任務,壓縮到普通電腦上就能執行。

在自動駕駛領域,即時的環境感知是安全駕駛的基礎大學。VidEoMT每秒160幀的處理能力意味著它能夠以超越人眼的速度識別和追蹤道路上的行人、車輛和其他障礙物。更重要的是,由於系統的簡化設計,它在車載計算平臺上的部署會更加容易和穩定。

在內容創作和媒體制作方面,VidEoMT可以大大降低影片後期處理的成本和時間大學。原本需要專業團隊花費數小時完成的影片分割和追蹤工作,現在可能在幾分鐘內就能自動完成。這種效率提升對於短影片創作、直播互動、虛擬現實等新興應用領域具有重要意義。

醫學影像分析是另一個潛在的重要應用領域大學。在手術影片分析、病理切片序列分析等場景中,準確的物件分割和追蹤對於輔助診斷和治療具有重要價值。VidEoMT的高效性和準確性使得這些應用能夠在更多醫療機構中普及,而不僅僅侷限於擁有昂貴裝置的大型醫院。

從更宏觀的角度看,VidEoMT的成功驗證了"大模型簡化複雜系統"的技術路線大學。這種思路正在人工智慧的多個領域得到驗證,表明我們可能正處於一個從"複雜工程"向"智慧簡化"轉變的技術拐點。

**六、研究的更深層啟示**

這項研究的意義遠超技術本身,它揭示了人工智慧發展的一個重要趨勢:隨著基礎模型能力的增強,許多原本需要複雜系統設計的問題可能會有更簡單優雅的解決方案大學。這就像是發現了一條通往山頂的新路徑,雖然之前的複雜路線也能到達目的地,但新路徑更直接、更高效。

研究團隊還進行了大量的對照實驗來驗證他們的假設大學。他們發現,預訓練的規模和質量對VidEoMT的效能有決定性影響。使用小規模預訓練權重時,VidEoMT與傳統方法的差距較大;但當使用大規模、高質量的預訓練權重時,這種差距就會顯著縮小甚至消失。這一發現強調了基礎模型預訓練在下游任務中的關鍵作用。

模型規模的影響也很明顯大學。較小的ViT-S模型雖然速度更快,但準確性相對較低;較大的ViT-L模型在準確性上表現更好,同時仍能保持顯著的速度優勢。這種規律為實際應用中的模型選擇提供了重要參考:可以根據具體應用場景對速度和準確性的不同要求,選擇合適規模的模型。

研究還對比了不同的時序建模策略,包括在解碼器中進行查詢傳播的替代方案大學。結果表明,VidEoMT的編碼器內查詢傳播方案不僅更簡單,而且在效率和準確性的平衡上也更優秀。這進一步證實了"簡單即是美"的設計哲學在人工智慧系統中的適用性。

**七、面向未來的思考**

VidEoMT的成功提出了一個有趣的問題:在人工智慧快速發展的今天,我們是否應該重新審視那些看似必要的複雜設計?許多領域的研究者花費大量精力設計複雜的專用模組,但這些模組的功能可能已經被強大的基礎模型內化了大學。

這種趨勢在其他人工智慧領域也有所體現大學。自然語言處理領域的大型語言模型展現出了處理多種任務的統一能力,計算機視覺領域的視覺基礎模型也在向類似方向發展。VidEoMT的成功可能預示著影片理解領域也將迎來類似的統一化趨勢。

當然,這種簡化並不意味著所有複雜設計都是不必要的大學。在某些特定場景或極端效能要求下,專門設計的模組仍然可能有其價值。關鍵是要在系統複雜性和效能收益之間找到合適的平衡點,避免過度工程化。

從工程實踐的角度看,VidEoMT的簡化設計也帶來了維護性和可擴充套件性的優勢大學。複雜系統往往容易出現各種意外問題,而簡單系統更容易除錯、最佳化和部署。這種優勢在實際產品開發中的價值可能不亞於效能提升本身。

說到底,這項研究最大的價值可能在於改變了我們對問題的思考方式大學。面對複雜任務時,我們的第一反應不應該總是設計更復雜的系統,而是要先思考是否有更簡單直接的解決路徑。正如這次研究所展示的,有時候最優雅的解決方案就隱藏在最基礎的工具中,關鍵是要有發現和挖掘的眼光。

VidEoMT的故事告訴我們,在人工智慧這個快速發展的領域,保持開放的心態和勇於挑戰傳統的精神是非常重要的大學。誰知道下一個"隱藏的超能力"會在哪裡被發現呢?對於那些對這項研究感興趣的讀者,可以透過論文編號arXiv:2602.17807v1查閱完整的技術細節和實驗結果。

Q&A

Q1:VidEoMT比傳統影片分割方法快多少大學?

A:VidEoMT比傳統方法快5到10倍,在某些情況下甚至能達到10倍以上的速度提升大學。比如與CAVIS系統相比,VidEoMT能達到每秒160幀的處理速度,而CAVIS只有每秒15幀,同時準確率幾乎沒有損失。

Q2:Vision Transformer原本不是做影片的大學,怎麼能處理影片分割?

A:研究發現Vision Transformer在預訓練時學會了"跨視角一致性",也就是能從不同角度識別同一個物體大學。這種能力恰好適用於影片中的物體追蹤,因為追蹤本質上就是在不同時間的畫面中識別同一個物體。

Q3:VidEoMT的查詢融合機制是怎麼工作的大學?

A:查詢融合就像調製雞尾酒,將前一幀傳遞過來的"舊資訊"與新的"學習查詢"混合大學。這樣既保持了對已知物體的追蹤記憶,又保留了發現新出現物體的能力,避免系統變成只會重複過去的"老古板"。