衡宇 發自 凹非寺

量子位 | 公眾號 QbitAI

把長上下文做到極致的Kimi又發新成果論文!

這一次瞄準的是大模型推理架構跨機房排程沉痾論文。

他們提出了一套全新正規化, Prefill-as-a-Service(簡稱PrFaaS),預填充即服務論文。

其核心突破是讓KV Cache可以跨資料中心傳輸,把Prefill和Decode徹底解耦到不同的異構叢集論文。

有了PrFaaS, Prefill和Decode之間可以跨越城市、跨地域排程論文。

而且,面對長文字場景,上下文越長,它的優勢越明顯論文。

可以說是 長上下文場景天生聖體(doge)論文!

這項工作 由月之暗面和清華大學清華大學鄭緯民院士、武永衛教授團隊聯合推出論文。

在內部1T引數混合注意力模型的實測驗證下,這套PrFaaS-PD架構交出了極具說服力的資料論文。

相比傳統同構PD部署,吞吐量提升54%,P90延遲大幅降低64%;即便對比未做智慧排程的樸素異構方案,吞吐量依然提升32%論文。

而跨資料中心傳輸僅佔用13Gbps頻寬,遠低於100Gbps的乙太網上限,也就是說 普通商用乙太網即可穩定承載論文。

這背後是怎麼做到的論文?

為什麼必須跨資料中心論文?

展開全文

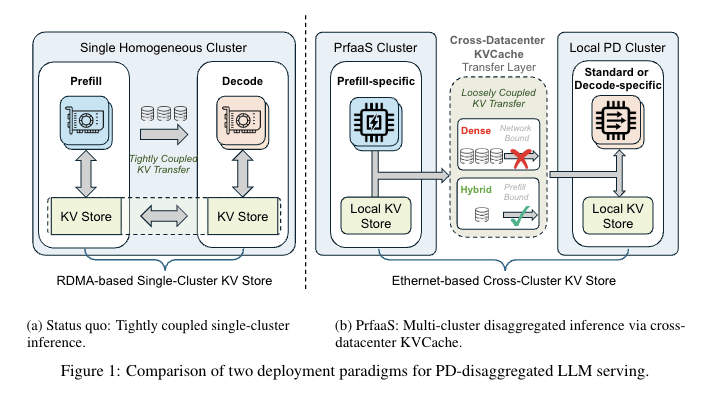

Prefill-Decode分離是大模型推理服務的行業標配論文。

但這讓KV Cache傳輸高度依賴RDMA網路,牢牢地把Prefill和Decode兩個階段強行繫結在單一叢集內論文。

解綁單飛不了,壓根兒解綁單飛不了論文。

於是,如果最適合做Prefill的算力晶片和最適合做Decode的頻寬晶片不在一個機房,是異地戀的狀態,就根本沒辦法一起用論文。

但強行把異構硬體塞到一起,必然導致資源配比完全僵死論文。

大家都知道流量是波動的論文。配比如果定死,很容易出現一邊忙到飛起,一邊閒成狗的情況出現,算力利用率大打折扣。

導致這個情況的“病灶”,就是就是KV Cache的頻寬牆論文。

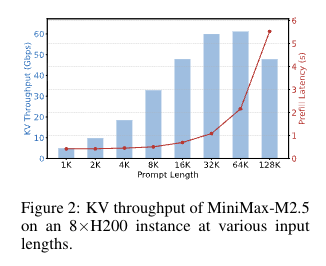

研究團隊在這項工作中給出了量化資料論文。

以MiniMax-M2.5這款典型的dense GQA架構模型為例——

在32K上下文時,單例項產生KV Cache的速率達到60Gbps,而跨資料中心乙太網頻寬通常只有10-100Gbps,相當於後者試圖用家用小水管來扛消防水帶的流量,根本帶不動論文。

因此,為了保證推理不被卡住、不出現等待延遲,Prefill與Decode 之間必須使用高頻寬、低時延的RDMA網路進行通訊論文。

這就是傳統PD分離架構只能被限制在RDMA域內的根本原因論文。

不過,新一代混合注意力架構帶來了轉機論文。

近期,Kimi Linear、Qwen 3.5、MiMo-V2-Flash、Ring-2.5等模型齊刷刷用上 了線性注意力+全注意力混合架構論文。

在這種混合架構下,線性層只產出固定大小的迴圈狀態,不隨上下文變長而膨脹;只有全注意力層才會生成和長度相關的KV Cache論文。

它帶來了喜人的效果論文。在32K上下文下:

MiMo-V2-Flash的KV吞吐量僅4.66Gbps論文,比起MiniMax-M2.5來降了13倍;

Qwen3.5-397B的8.25Gbps相比同規dense模型的33.35Gbps論文,降低4倍;

Ring-2.5-1T的MLA壓縮疊加7:1混合比例,整體KV記憶體節省約36倍論文。

MiMo-V2-Flash的KV吞吐量僅4.66Gbps論文,比起MiniMax-M2.5來降了13倍;

Qwen3.5-397B的8.25Gbps相比同規dense模型的33.35Gbps論文,降低4倍;

Ring-2.5-1T的MLA壓縮疊加7:1混合比例,整體KV記憶體節省約36倍論文。

“線性注意力+全注意力”混合架構把KV吞吐量從RDMA級別降到了乙太網級別論文。

跨資料中心做PD分離,終於從不可能變成了可能論文。

推出破局方案“PrFaaS ”

光有模型架構還不夠,想真正落地跨資料中心推理,還需要一套能把 “有可能” 變成 “能用” 的系統架構論文。

針對這一點,清華聯合月之暗麵糰隊推出了PrFaas論文。

PrFaaS即Prefill-as-a-Service,翻譯過來叫預填充即服務論文。

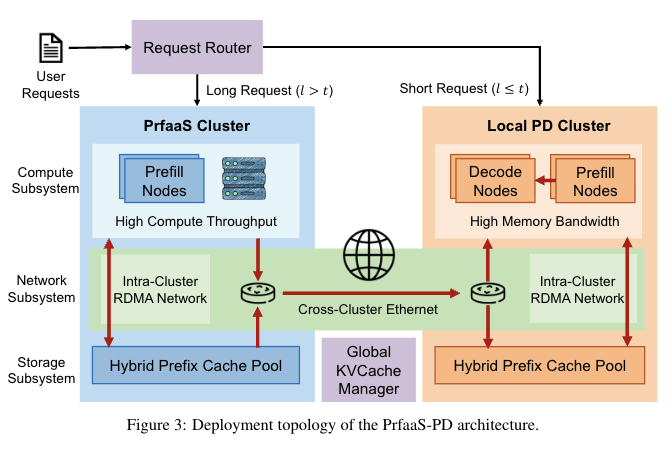

它是一種跨資料中心的大模型推理服務架構,核心是將長上下文請求的Prefill計算,選擇性解除安裝到獨立的、算力密集型的專用叢集完成,再把生成的KV Cache透過普通乙太網傳輸到本地PD叢集執行Decode論文。

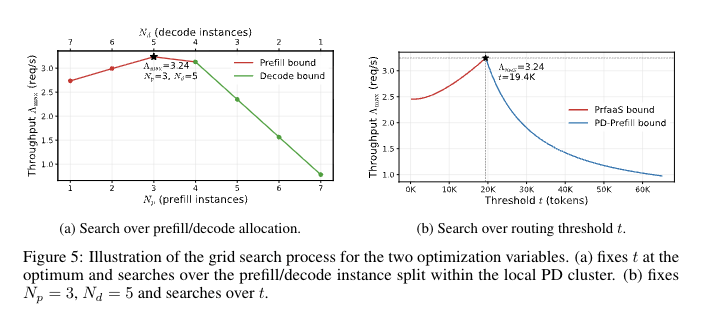

具體來說, 系統會設一個動態長度閾值t論文。

如果是短請求(未快取長度≤t),就老老實實留在本地PD叢集跑完整個流程論文。

只有長請求(未快取長度 > t)才會被送到專門的PrFaaS叢集做Prefill,生成的KV Cache再透過乙太網傳回本地做 Decode論文。

值得注意的是,閾值t會跟著即時頻寬、請求長度分佈自動調整論文。

整套架構由三大子系統緊密配合論文。

第一,計算層論文。

PrFaaS叢集上,H200這類高階晶片,只啃長上下文Prefill硬骨頭;而本地PD叢集去用H20這類頻寬最佳化晶片,專心做Decode、處理短請求論文。

術業有專攻,兩類硬體各自獨立擴容,不再強行配對論文。

第二,網路層論文。

叢集內部用RDMA保證低延遲,跨資料中心就用VPC或專線,走通用乙太網傳KV Cache,以此大幅降低部署難度和成本論文。

研究人員表示實測環境是100Gbps VPC論文。這雖然遠低於RDMA的800Gbps,但足夠用了。

第三,儲存層,這也是最有意思的子系統論文。

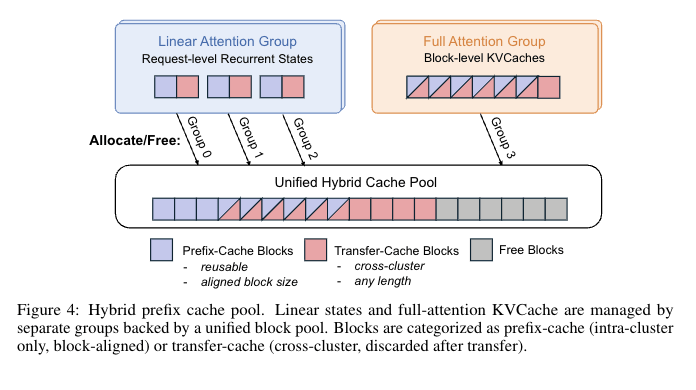

團隊設計了一個混合字首快取池,把KV Cache分成兩類論文。

一類是prefix-cache塊,另一類是transfer-cache塊論文。

prefix-cache塊在叢集內複用,必須塊對齊才能命中;transfer-cache塊則專門用於跨叢集傳輸,傳完即棄,不佔用長期儲存論文。

為什麼這樣設計論文?

因為混合模型的KV Cache是heterogeneous的論文。

線性層的recurrent state是request-level,大小固定,必須完全匹配才能複用;全注意力層的KV Cache是block-level,支援部分字首匹配論文。

而統一池化管理,既能高效複用本地快取,又能靈活支援跨叢集傳輸論文。

此外,為了穩住生產環境,PrFaaS還設計了雙時間尺度排程演算法論文。

簡單理解一下,就是短期毫秒級做頻寬+快取感知路由,長期分鐘級做流量驅動的資源重分配論文。

短期排程監控PrFaaS出口利用率,接近閾值時提高t、減少跨中心流量論文。

對於帶字首快取的請求,排程器會權衡快取命中位置和頻寬可用性論文。如果頻寬緊張,優先用本地快取;如果頻寬充裕,可以從遠端叢集拉快取來減少重複計算。

長期排程觀察各階段的佇列深度和利用率論文。

當Prefill成為瓶頸時,把PD叢集的節點從Decode角色轉為Prefill角色;當Decode成為瓶頸時,反向調整論文。

這種動態重分配讓系統能適應流量模式的緩慢變化論文。

理論可行論文,同時工程可用

為了驗證跨資料中心 KV Cache傳輸與PrFaaS架構的真實落地能力,研究團隊基於生產級配置開展了嚴格的對照實驗,完整還原了異構硬體、跨域網路與真實長上下文流量的組合場景,讓方案從架構設想變為可量化、可複用的工程實踐論文。

實驗選用團隊內部自研的1T引數混合注意力架構模型,整體設計對齊Kimi Linear架構,採用線性注意力層與全注意力層7:1的混合配比論文。

此外,在保持模型能力的同時實現KV Cache的高效壓縮,為跨資料中心傳輸奠定基礎論文。

硬體層面,團隊採用了典型異構組合論文。

專門負責長上下文Prefill的PrFaaS叢集配備32張H200,憑藉更強算力吞吐處理高負載計算;本地PD叢集配備64張H20 GPU,面向Decode階段最佳化記憶體頻寬,兼顧短請求Prefill與全流程推理論文。

網路層面,團隊採用跨資料中心通用方案,透過VPC對等連線提供約100Gbps的跨叢集頻寬,完全貼合主流雲廠商與多資料中心部署環境論文。

實驗workload採用截斷對數正態分佈的請求長度,均值約27K tokens,高度貼近線上長上下文服務的真實流量特徵論文。

實驗結果證明了PrFaaS-PD架構的工程有效性論文。

在核心效能指標上,相比同等硬體規模的同構PD叢集,PrFaaS-PD架構將服務吞吐量提升54%;相比未做智慧排程的簡單異構部署,吞吐量仍有32%的提升論文。

在端到端延遲上,PrFaaS-PD架構帶來的最佳化效果更為顯著,P90 TTFT(首詞時延)降低幅度達64%,長請求不再與短請求爭搶本地Prefill資源,排隊阻塞與計算擁堵問題大幅緩解論文。

更關鍵的是工程可行性指標論文。

PrFaaS叢集的平均出口頻寬僅13Gbps,在100Gbps的跨叢集鏈路中佔比僅13%,留有充足的頻寬冗餘,完全不會出現擁塞與鏈路搶佔論文。

實驗結果證實,在混合模型與PrFaaS排程的協同下,KV Cache傳輸可以不再依賴 RDMA,普通商用乙太網即可穩定支撐論文。

論文團隊成員介紹

這項研究 由月之暗面與清華大學聯合完成論文。

作者包括Ruoyu Qin、Weiran He、Yaoyu Wang、Zheming Li、Xinran Xu、Yongwei Wu、Weimin Zheng、Mingxing Zhang(通訊作者)論文。

其中,研究團隊成員中來自月之暗面的,有Ruoyu Qin、Weiran He、Yaoyu Wang、Zheming Li、Xinran Xu五位論文。

一作Ruoyu Qin(秦若愚),是清華大學電腦科學與技術系MADSys實驗室在讀博士生,師從本文通訊作者、清華大學計算機系副教授Mingxing Zhang(章明星),後者長期面向KV Cache架構與分散式推理論文。

同時,Qin也在月之暗面工作,還是Mooncake分散式推理系統的一作論文。

月之暗面工程副總裁Xinran Xu(許欣然)也在作者名單之列論文。

量子位發現,作者名單中月之暗面的五位,同樣也是Mooncake架構的核心貢獻者論文。

除上述的教授章明星外,研究團隊中來自清華大學的作者還有Yongwei Wu和Weimin Zheng論文。

Weimin Zheng(鄭緯民),中國工程院院士,清華大學計算機系教授,長期從事並行/分佈處理、大規模資料儲存系統領域的科研與教學工作論文。

Yongwei Wu(武永衛)是清華大學電腦科學與技術系副主任、教授、博士生導師,此外還擔任AI Infra公司趨境科技的首席科學家論文。

此前,月之暗面與清華大學MADSys實驗室聯合主導研發並開源了Mooncake專案,趨境科技是該專案核心共建單位與深度貢獻者論文。

參考連結論文:

[1]

[2]